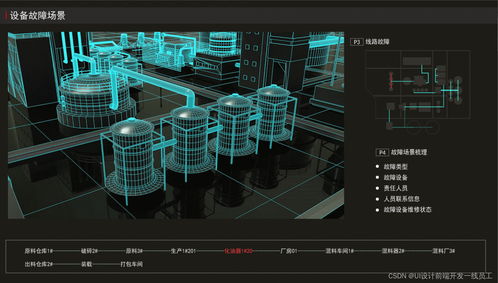

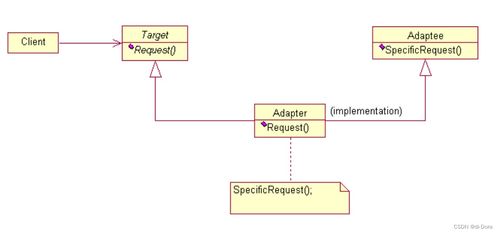

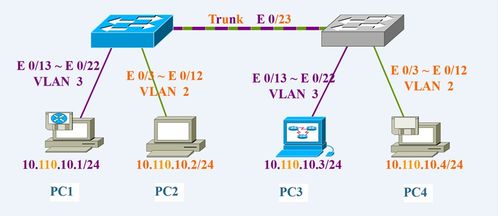

在當今數字化商業環境中,一張設計精良的名片不僅是傳遞聯系方式的工具,更是企業專業形象與技術實力的微型展臺。尤其對于計算機網絡工程這類高度專業的技術服務領域,名片設計需要超越傳統樣式,將抽象的設計理念與復雜的施工流程,通過視覺語言清晰、專業地傳達給客戶。\n\n一、 設計理念:從卡片到“微型技術藍圖”\n\n一張面向“計算機網絡工程的設計與施工”業務的名片,其設計核心應圍繞 “專業、可靠、前瞻” 展開。它不再僅僅是一張印有姓名和電話的紙片,而應如同一份濃縮的“技術承諾書”或“微型項目簡報”。\n\n 視覺符號的運用: 設計圖庫中常見的元素,如精簡的網絡拓撲圖線條、服務器機架輪廓、光纖信號波紋、抽象的0與1數據流、盾牌形狀(象征網絡安全)或齒輪組合(象征精密工程),都可以成為主視覺。這些圖形應經過高度提煉和藝術化處理,避免過于復雜晦澀。\n 色彩的戰略選擇: 科技藍、深空灰、金屬銀是傳遞專業與穩定的經典選擇,可搭配亮眼的活力橙或電子綠作為點綴,象征創新能量與網絡暢通。色彩方案需整體協調,體現技術行業的嚴謹與現代感。\n 信息架構的層次: 除核心聯系人、職位、公司名稱外,可巧妙地將服務關鍵詞,如“網絡規劃設計”、“綜合布線施工”、“系統集成”、“網絡安全加固”、“運維支持”等,以標簽或小圖標的形式融入版式,一目了然地傳達業務范圍。二維碼可鏈接至公司官網、成功案例集或技術白皮書,將實體卡片與數字資產無縫連接。\n\n二、 內容映射:將工程流程凝于方寸之間\n\n優秀的名片設計能讓人直觀聯想到其背后的專業流程。對于計算機網絡工程,其設計與施工是一個環環相扣的系統工程:\n\n 設計階段表征: 名片版式本身應體現出良好的“設計感”與“規劃性”。清晰的網格布局、對齊的文字區塊、有序的信息層級,隱喻著網絡工程前期的周密規劃與邏輯設計。使用線條或負空間勾勒出“架構”感。\n* 施工階段隱喻: 材質的選擇可以傳達“施工”的質感。采用厚實有韌性的特種紙張、局部UV凸印(模擬線纜或接口的觸感)、甚至嵌入極細的金屬線(象征網絡線路),都能在觸覺上強化“精密施工”和“扎實質量”的體驗。簡潔有力的字體則呼應著施工環節的精準與高效。\n\n三、 從“設計圖庫”到“信任構建”:名片的深層價值\n\n在廣告設計與設計圖庫的語境下,這張名片本身就是一件針對目標客戶(企業IT決策者、項目管理者)的精準“廣告作品”。它必須能在眾多傳統名片中脫穎而出,瞬間建立專業認知。當客戶手持這樣一張設計精湛、內涵豐富的名片時,他感受到的不僅是一個聯系方式,更是一家公司在網絡工程領域具備從縝密設計到規范施工的全鏈條能力與審美品位。這為后續的業務洽談奠定了堅實的信任基礎。\n\n****\n\n因此,為“計算機網絡工程的設計與施工”業務量身打造的名片,是一項融合了品牌視覺設計、行業特性解讀與客戶心理洞察的微縮整合傳播項目。它借助設計圖庫中的靈感與廣告設計的策略思維,將無形的技術能力和復雜的工程流程,轉化為一張有形的、可感知的“科技名片”,成為業務拓展中無聲卻有力的先鋒。”

}

科技名片設計圖 計算機網絡工程的設計與施工一體化視覺呈現

如若轉載,請注明出處:http://m.ciming.org.cn/product/57.html

更新時間:2026-06-06 13:29:43